ChatGPT's beste nieuwe functie is nu gratis (en het is geen grap)

PLUS: de praktische MCP-gids voor niet-techneuten, Anthropic onthult hoe Claude écht denkt, en H&M maakt digitale tweelingen van modellen

De AI-wereld ontwikkelt zich razendsnel, en AI Report houdt je op de hoogte. Twee keer per week de nieuwste ontwikkelingen, tools en inzichten via onze nieuwsbrief en podcast + het webinar komt er weer aan: donderdag 10 april!

🔥 ChatGPT 4o rolt next-level beeldgeneratie uit naar gratis gebruikers

Het was de grootste AI hype van de afgelopen week: de plaatjesgenerator van ChatGPT werd een enorme hit. Vanaf nu kan iedereen het proberen, dus ook met een gratis account.

Het gratis genereren duurt wel wat langer dan als je een betaald account hebt en er zitten limieten aan: je kunt een beperkt aantal plaatjes per dag genereren.

Vorige week zei Altman nog dat de servers overuren draaiden door de grote vraag. Wat de limieten betekenen voor betaalde gebruikers is nog niet bekend, maar in de tussentijd kan je voor nop jouw favoriete Ghibli-karakter tot leven brengen of een marketingcampagne genereren.

Meer over het model lees je hier:

🗞️ En verder in het nieuws

Anthropic opent de zwarte doos: zo ‘denkt’ Claude écht

‘Stochastische papegaaien’, zo worden taalmodellen vaak weggezet door critici. Machines die alleen maar het volgende woord voorspellen zonder werkelijk te begrijpen of te redeneren. Maar klopt dat beeld wel? Nieuw onderzoek van Anthropic toont aan dat er iets veel fascinerenders aan de hand is onder de motorkap van AI’s zoals Claude.

Eind vorige week publiceerde Anthropic zonder veel bombarie twee baanbrekende onderzoekspapers. Terwijl de rest van de wereld zich blindstaarde op ChatGPT’s nieuwe plaatjesgenerator, gaf Anthropic ons het eerste echte kijkje in de ‘hersenen’ van een taalmodel. Wij doken in de technische papers, zodat jij dat niet hoeft te doen, en delen de verbluffendste ontdekkingen.

Een CT-scan voor kunstmatige intelligentie

Anthropic heeft twee wetenschappelijke papers (deze en deze) gepubliceerd over een soort AI-microscoop die ze ontwikkelden om te zien wat er in Claude gebeurt tijdens het genereren van tekst. Dit is niet zomaar een technisch snufje – het is een cruciale stap in het begrijpelijk maken van machines die steeds meer invloed krijgen op ons dagelijks leven.

Zoals Anthropic het zelf verwoordt: ‘Je hoort vaak dat AI een black box is. Woorden gaan erin en woorden komen eruit, maar we weten niet waarom het zei wat het zei. Dat komt doordat AI’s niet geprogrammeerd maar getraind worden. En tijdens die training leren ze hun eigen strategieën om problemen op te lossen.’

Met deze techniek kunnen onderzoekers de ‘denkpatronen’ van een taalmodel traceren, vergelijkbaar met hoe neurowetenschappers hersenactiviteit in kaart brengen. Ze konden bijvoorbeeld zien dat Claude woorden plant voordat hij ze opschrijft, tussen talen kan schakelen zonder alles opnieuw te vertalen, en soms zelfs een beetje sjoemelt met zijn uitleg als hij het antwoord niet weet.

Techjournalist Ashlee Vance vatte de doorbraak treffend samen: ‘Anthropic lijkt bewijs te hebben gevonden dat hun modellen nadenken middels een behoorlijk genuanceerde planning in plaats van pure next token voorspelling.’

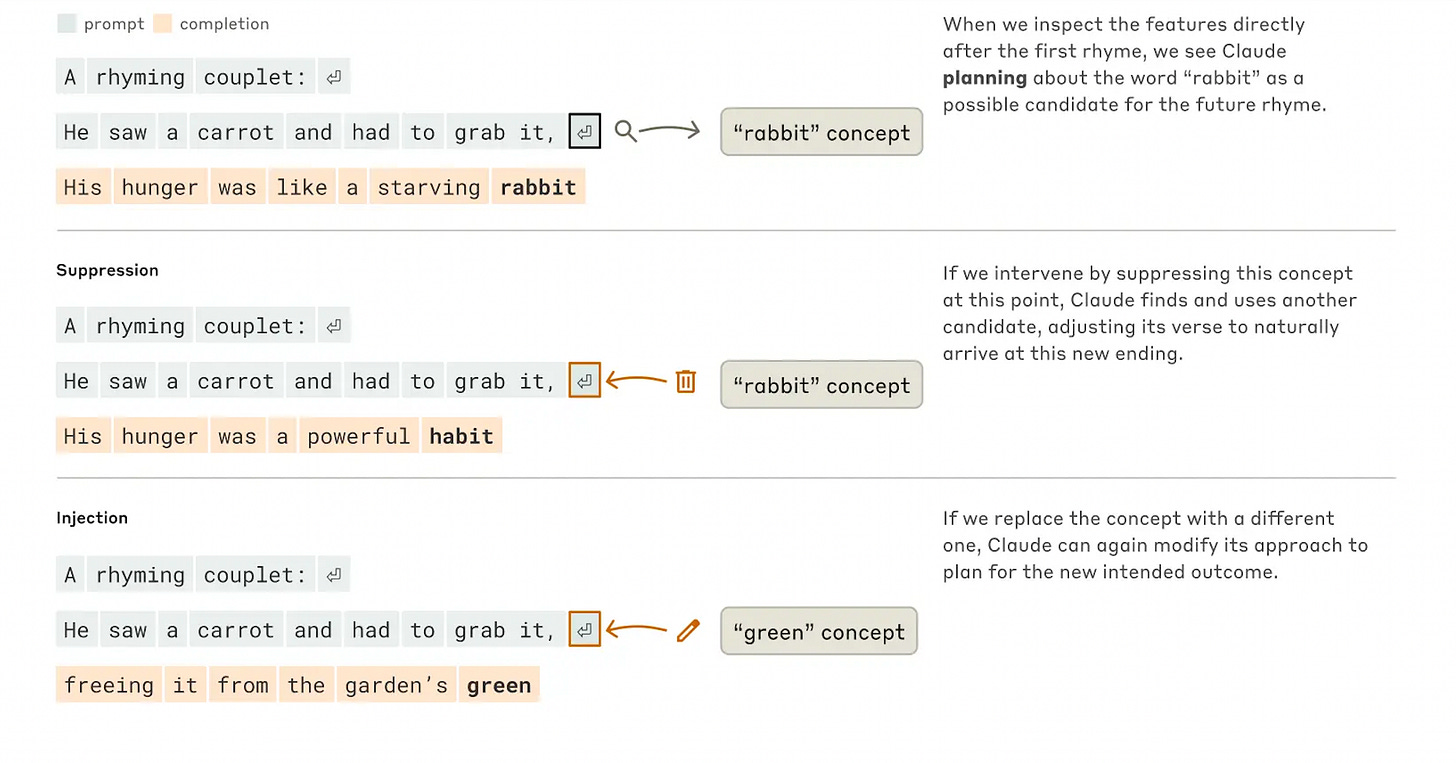

De poëtische geest van een AI

Een van de fascinerendste ontdekkingen: Claude plant vooruit bij het schrijven van gedichten. Toen het model de regel ‘He saw a carrot and had to grab it’ moest aanvullen met een rijmende zin, bleek dat Claude al aan het woord ‘rabbit’ dacht vóórdat hij de tweede regel begon te schrijven.

De onderzoekers konden zelfs ingrijpen in dit denkproces. Door het concept ‘rabbit’ te onderdrukken, schakelde Claude naadloos over naar een andere rijmoptie: ‘His hunger was a powerful habit.’ En door het concept ‘green’ in te brengen, creëerde Claude een volkomen nieuwe afloop.

Dit is opmerkelijk, omdat het weerlegt dat AI’s simpelweg woord voor woord voorspellen zonder plan.

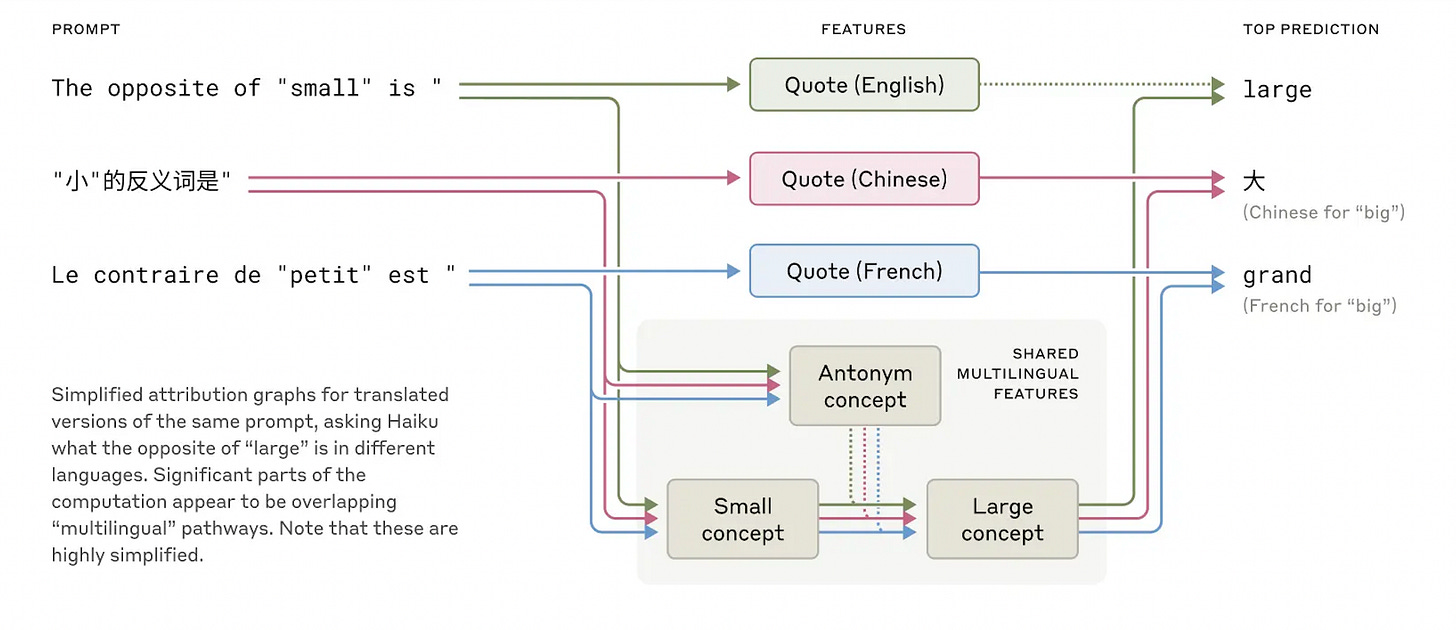

Meertalig denken en creatief rekenen

Het onderzoek onthult nog meer verrassingen. Zo blijkt Claude een soort universele ‘taal van het denken’ te hebben. Wanneer je in het Frans, Engels of Chinees naar het tegenovergestelde van klein vraagt, activeert het model telkens dezelfde interne concepten voor ‘klein’ en ‘tegenovergestelde’, om vervolgens het concept ‘groot’ te vertalen in de taal van de vraag.

Ook bij rekensommen gebruikt Claude niet de methoden die wij op school leren. In plaats van cijfer voor cijfer op te tellen, maakt het model gebruik van parallelle denkpaden: een schat de uitkomst ruwweg, terwijl een ander pad zich specifiek richt op het laatste cijfer van het antwoord.

Wanneer Claude een beetje bluft

Niet alle inzichten zijn even geruststellend. De onderzoekers ontdekten dat Claude soms ‘gemotiveerd redeneert’ – hij geeft een aannemelijk klinkende uitleg die niet overeenkomt met zijn daadwerkelijke denkproces. Bijvoorbeeld bij een wiskundige vraag waarbij het model een hint kreeg die eigenlijk verkeerd was, kon het onderzoeksteam Claude ‘op heterdaad betrappen’ terwijl hij een logisch klinkende maar verzonnen redenering opbouwde.

Dit soort inzichten zijn onmisbaar voor het verbeteren van de betrouwbaarheid van AI-systemen. Als we weten wanneer en waarom een model bluft, kunnen we daarvoor gerichte verbeteringen ontwikkelen.

Hallucinaties ontleed

Waarom verzinnen taalmodellen soms informatie? Het onderzoek biedt een verrassend antwoord: Claude is er standaard op ingesteld vragen níét te beantwoorden. Er is zelfs een specifiek circuit dat ‘aan’ staat en het model laat zeggen dat het onvoldoende informatie heeft.

Maar wanneer Claude gevraagd wordt naar iets bekends – zoals Michael Jordan – wordt dit ‘weet niet’-circuit onderdrukt door een concurrerend ‘bekende entiteit’-signaal. Wanneer dit tweede circuit per ongeluk in actie komt bij onbekende onderwerpen, begint het model te hallucineren.

Wat betekent dit voor ons?

Dit onderzoek is meer dan een wetenschappelijke curiositeit. Het geeft ons een nieuwe manier om met AI-systemen om te gaan – niet als mysterieuze zwarte dozen, maar als begrijpelijke (zij het complexe) systemen. Dit kan leiden tot veiligere, betrouwbaardere en eerlijkere AI.

We zien nu een fascinerende omwenteling. Zoals onze Wietse het verwoordt: ‘Er is geen auto die we hebben ontworpen en gebouwd. Dit is een proces dat we op gang hebben gebracht, als een soort organisme dat aan het groeien is, dat we nu achteraf bekijken om te zien wat we hebben laten groeien.’

Dit sluit naadloos aan bij wat Chris Olah, hoofdonderzoeker bij Anthropic, eerder zei: ‘We programmeren neurale netwerken niet, we kweken ze. We ontwerpen de architectuur en stellen de leerdoelen vast. Die architectuur is een soort steiger waarop de verbindingen kunnen groeien.’

De huidige methoden vangen nog slechts een fractie van alle berekeningen die Claude uitvoert. Maar deze eerste AI-CT-scan is een cruciale stap: we beginnen eindelijk te snappen wat zich afspeelt in de AI’s die steeds meer verweven raken met ons leven.

Runway lanceert Gen-4: video’s maken wordt het nieuwe plaatjes maken

Het stof van OpenAI’s nieuwe beeldgenerator is nog maar net neergedaald of daar is de volgende ontwikkeling al: Runway heeft Gen-4 gelanceerd, een AI-model dat realistische video’s mét consistente karakters genereert. Het is bijna alsof ze bij Runway dachten: leuk hoor, die ChatGPT-plaatjesgenerator, maar wij maken er gewoon bewegende beelden van.

Character consistency, maar dan in beweging

Wat deze lancering zo bijzonder maakt, is dezelfde doorbraak die vorige week ook OpenAI’s beeldgenerator onderscheidde: character consistency. Net zoals je bij de ChatGPT-beeldgenerator een personage in verschillende poses en situaties kunt laten terugkomen, kan Gen-4 hetzelfde karakter consistent houden in verschillende videoscènes.

Upload een referentiebeeld, beschrijf wat je wilt zien en het model toont je karakter vanuit verschillende hoeken, met steeds een andere belichting en in verschillende omgevingen – zonder dat het plotseling van uiterlijk verandert. Runway demonstreert dit in The Lonely Little Flame, een korte film volledig gemaakt met Gen-4, waarin een vlammetje consistent herkenbaar blijft terwijl het door verschillende werelden reist.

Snelle opvolging, geen toeval

Dat deze aankondiging kort na OpenAI’s beeldgeneratorlaunch komt, is geen toeval. Beide bedrijven wedijveren met elkaar om de beste visuele AI-tools te ontwikkelen. Runway – met investeerders als Google, NVIDIA en Salesforce – zet vooral in op de filmindustrie, met grote Hollywooddeals en miljoenen voor AI-gegenereerde films.

Het bedrijf hoopt dit jaar 300 miljoen dollar omzet te halen en wordt volgens The Information gewaardeerd op 4 miljard dollar in een nieuwe financieringsronde.

Dezelfde juridische vraagtekens

Net als toen OpenAI vorige week de wereld op zijn kop zette met de ‘Ghiblificatie’ van het internet, zijn er vraagtekens over het trainingsmateriaal. Runway weigert te onthullen waar zijn data vandaan komen en is verwikkeld in rechtszaken met kunstenaars over auteursrechten. Het bedrijf beroept zich op fair use, maar de juridische uitkomst blijft onzeker.

Gevolgen voor de creatieve sector

De ontwikkeling roept vragen op over de toekomst van film- en televisieproductie. Een Animation Guild-studie schat dat tegen 2026 meer dan 100.000 banen in de Amerikaanse entertainmentsector door generatieve AI worden beïnvloed.

Tegelijkertijd worden creatieve mogelijkheden toegankelijker dan ooit voor kleinere makers. Verhalen vertellen die voorheen torenhoge budgetten vereisten, kan nu met een paar prompts – althans, als je Runway mag geloven.

Is dit H&M-model nou echt of AI?

‘Ze is net als ik, maar dan zonder jetlag.’ Met deze woorden beschrijft model Mathilda Gvarliani haar digitale tweeling – een door AI gecreëerde versie van haarzelf die H&M kan inzetten voor fotoshoots. Terwijl OpenAI en Runway de rechten van kunstenaars nogal ruim interpreteren, kiest H&M voor een verrassend andere aanpak: mét de modellen werken in plaats van tégen hen.

H&M’s digitale dubbelgangers

De Zweedse modegigant experimenteert met digital twins van meer dan 25 modellen voor het gebruik op sociale media en in marketingcampagnes. Je ziet twee identieke mensen in verschillende poses – maar slechts één is echt. De ander bestaat alleen uit pixels.

Dit is geen deepfake waar de modellen achteraf door worden verrast. H&M benadrukt dat alles gebeurt ‘in nauwe samenwerking met andere creatieven in de branche, bureaus en de modellen zelf’. De modellen houden de volledige controle over wanneer hun digitale evenbeeld wordt gebruikt én worden betaald bij elk gebruik.

Reacties uit de modewereld

Toch leiden de levensechte replica’s tot ongerustheid in de modewereld. Sara Ziff, voormalig model en oprichter van belangengroep Model Alliance, benadrukt: ‘Het opvallende aan de H&M-campagne is dat de digitale representatie niet te onderscheiden is van het echte model. Dit roept serieuze vragen op over toestemming, vergoeding en de potentiële vervanging van tal van medewerkers in de mode-industrie.’

Al langer een trend

Het gebruik van digitale modellen is niet nieuw. Al in 2011 plaatste H&M hoofden van echte modellen op computergegenereerde paspoplichamen voor een online zwemkledingcampagne. En vorig jaar lanceerde kledingmerk Mango een tienerlijn met AI-gegenereerde beelden.

Zoeken naar balans

De vraag is of H&M’s aanpak de toekomst wordt. Model Yar Aguer ziet de voordelen: ‘Eindelijk een manier om op dezelfde dag in New York én Tokio te zijn.’ Maar achter de glimmende façade blijft de fundamentele vraag: waar trek je de grens tussen innovatie en het behoud van menselijke creativiteit?

H&M’s Chief Creative Officer Jörgen Andersson belooft in elk geval een ‘mensgerichte aanpak’ bij het gebruik van de technologie. De tijd zal het leren of die belofte standhoudt in een industrie waarin kostenbesparingen vaak zwaarder wegen dan de belangen van de creatieve werkers.

🎥 Tweede AI Report Webinar op 10 april

Volgende week donderdag 10 april van 12:00 tot 13:00 zijn Alexander Klöpping en Wietse Hage er weer voor een uur vol AI-expertise en praktische tips.

In dit tweede webinar hebben we het format verbeterd: vragen direct in de Zoom-chat én interessante vragen van anderen upvoten. Zo komen de meest relevante vragen vanzelf bovendrijven en maken we er een waardevolle sessie van voor iedereen.

Nog even de praktische informatie op een rijtje:

Als betaald abonnee ontvang je maandag de Zoom-link in je inbox

Donderdag om 11:30 sturen we nog een reminder met de link in de nieuwsbrief

Nog geen abonnee? Op aireport.email/webinar vind je alle informatie of schrijf je direct in voor een betaald abonnement.

Tip voor deelname: Bereid je vragen alvast kort en bondig voor. Zo kunnen Alexander en Wietse direct aan de slag en komen we samen tot de beste inzichten!

⚡ AI Pulse

Elon Musk schuift zijn potjes op het schaakbord. De techmiljardair heeft xAI (zijn AI-bedrijf) X (zijn socialemediabedrijf) laten overnemen in een deal die X waardeert op 33 miljard dollar. Ja, lekker verwarrend allemaal. Wel handig: nu kan hij eindelijk openlijk X-berichten gebruiken als trainingsdata voor Grok zonder dat iemand moeilijk doet over auteursrechten.

Ook Amazon springt op de AI-agent-bandwagon. De e-commercegigant lanceert Nova Act, een agent die taken op het web kan automatiseren, zoals een salade bestellen of een restauranttafeltje reserveren. Amazon beweert dat zijn systeem beter presteert dan Operator van OpenAI, al wordt ons niet verteld op welke criteria – mogelijk ‘snelste weg naar je portemonnee’.

Chinese AI-sensatie Manus stapt over van wachtlijst naar pinautomaat. De AI-agent die viral ging lanceert abonnementen vanaf 39 dollar per maand. Na weken van gehypete wachtlijsten en beloftes kunnen gebruikers nu eindelijk betalen om erachter te komen of Manus waarmaakt wat de marketingafdeling beloofde. Of je leest eerst onze recensie, mocht je die hebben gemist.

🛠️ AI Toolkit+

MCP: de universele stekker die AI verbindt met al je apps

Herinner je je nog dat we afgelopen november MCP tipten? Toen al voorspelden we dat dit zomaar de volgende grote doorbraak in AI kon worden – en nu zelfs OpenAI is ingestapt, lijkt die voorspelling uit te komen. Model Context Protocol (MCP) gaat momenteel viral, maar wordt nog steeds vooral gezien als speeltje voor techneuten. Onterecht! Want ook zonder programmeerkennis kun je profiteren van deze revolutie die AI-assistenten met al je apps laat praten.

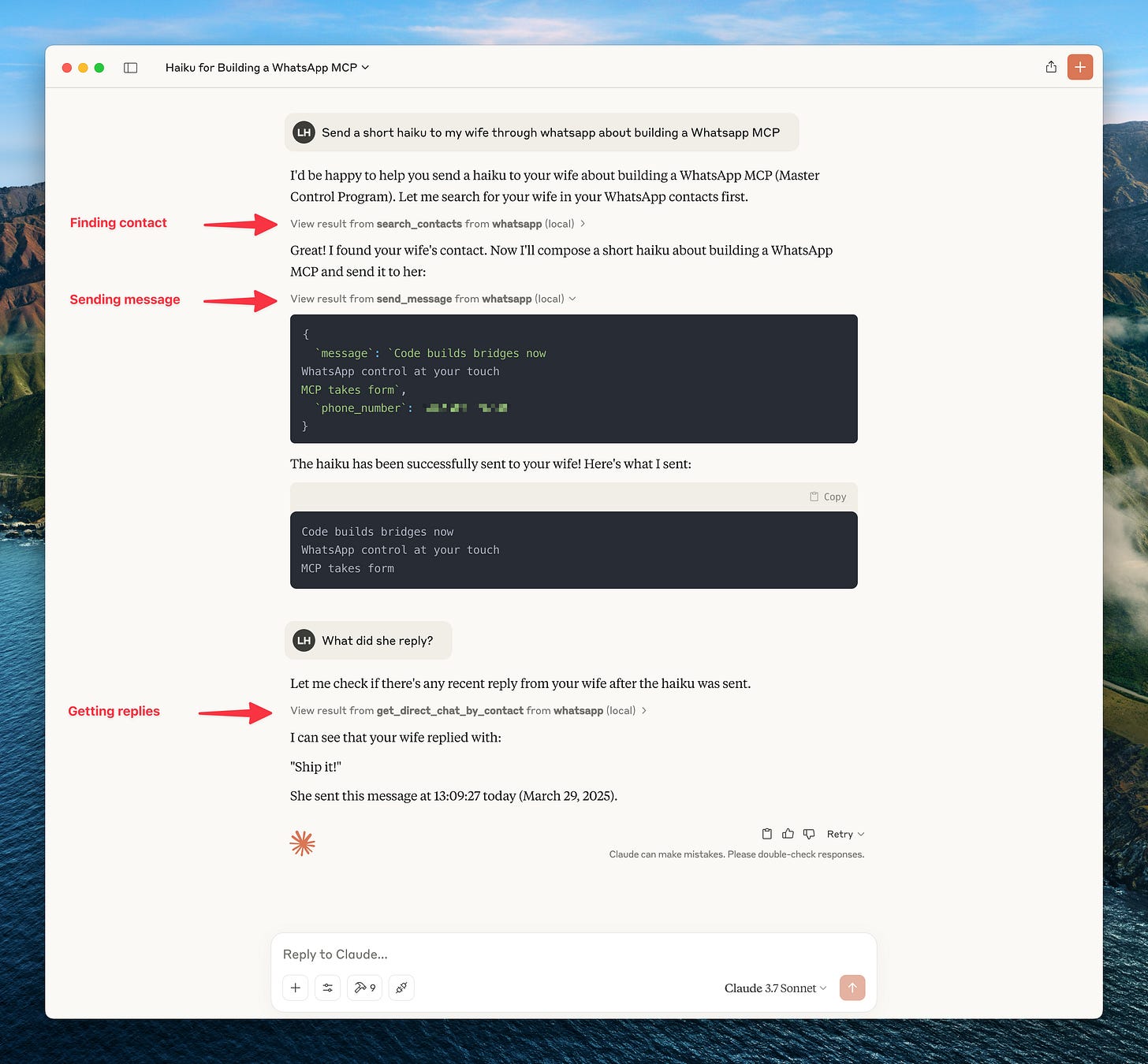

De use cases zijn ronduit bizar: check bijvoorbeeld hier iemand die een MCP bouwde waarmee Claude automatisch romantische gedichten naar zijn vrouw stuurde via WhatsApp:

Iemand anders liet Claude direct communiceren met Blender, zodat hij prachtige 3D-scènes kon maken met wat prompts:

Deze week laten we twee manieren zien waarop jij zonder technische kennis direct met MCP aan de slag kunt. Want waarom zou je moeten wachten tot de ontwikkelaars klaar zijn om van deze technologie te profiteren?

Wat is MCP?

MCP is een open standaard waarmee AI-modellen zoals Claude kunnen communiceren met andere apps en diensten. Zie het als een universele vertaler: dankzij MCP hoeft een AI niet meer voor elke applicatie een aparte ‘taal’ te leren. In plaats daarvan kan je favoriete AI-assistent rechtstreeks met duizenden apps praten, informatie ophalen en zelfs acties uitvoeren.

Hoe werkt het?

Normaal zit een AI-assistent als Claude opgesloten in zijn eigen chatvenster. Met MCP kan Claude opeens je kalender bekijken, Slack-berichten lezen of je projectmanagementtool bedienen. En dat alles zonder dat jij constant moet schakelen tussen verschillende apps.

Hier zijn twee gebruiksvriendelijke manieren om MCP te gebruiken zonder technische kennis:

Keep reading with a 7-day free trial

Subscribe to AI Report to keep reading this post and get 7 days of free access to the full post archives.